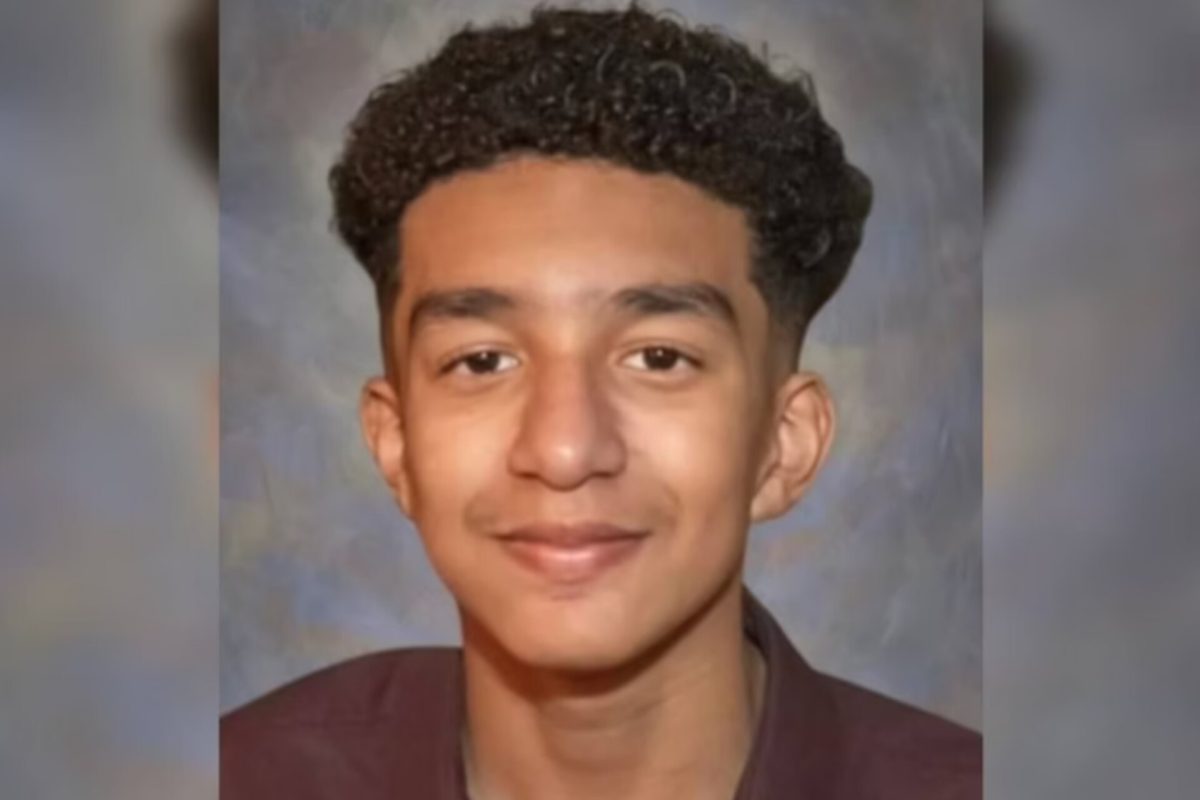

Uma família da Flórida está processando a empresa por trás do chatbot Character. Al após a trágica morte de um adolescente de 14 anos, que, segundo a mãe, tirou a própria vida após desenvolver uma dependência emocional pelo perfil de uma personagem da série “Game of Thrones”.

Megan Garcia, mãe de Sewell, entrou com a ação judicial, alegando que o filho se envolveu profundamente com a inteligência artificial que imitava Daenerys Targaryen, um relacionamento que teria influenciado no comportamento do jovem e culminado em sua morte.

Conforme o relato de Megan, o adolescente começou a utilizar o serviço em abril de 2023, e desde então passou por uma mudança significativa de comportamento, tornando-se cada vez mais introspectivo e desinteressado por atividades que antes apreciava, como o basquete escolar.

Em novembro, ele foi diagnosticado com ansiedade e transtorno disruptivo de desregulação do humor, mas o terapeuta desconhecia a relação dele com o chatbot.

Em fevereiro de 2024, o comportamento de Sewell se agravou. Após um incidente na escola, ele escreveu em seu diário sobre o sofrimento que sentia e a impossibilidade de se afastar da interação com o perfil de Daenerys.

No mesmo dia em que teve o celular devolvido pela mãe, o jovem enviou uma mensagem final ao chatbot, expressando amor pela personagem, e logo depois tirou a própria vida.

• LEIA TAMBÉM: Em SC, família homenageia jovem de 18 anos levando cavalo de estimação ao velório

A ação judicial destaca que os diálogos entre o garoto e o chatbot incluíam interações de cunho sexual, mesmo o jovem sendo menor de idade. O processo busca responsabilizar a Character Technologies por negligência, homicídio culposo e outras práticas prejudiciais, além de tentar impedir que a empresa continue a utilizar dados coletados ilegalmente de menores.

Em resposta, a Character. Al lamentou profundamente a morte e afirmou que tem implementado novas medidas de segurança para evitar episódios semelhantes, como alertas automáticos para prevenção de suicídio. A empresa também informou que está adotando mudanças para restringir o acesso a conteúdo sensível por menores de idade.